La empresa OpenAI habilitó una nueva función de seguridad en su plataforma de inteligencia artificial para proteger la integridad de sus usuarios adultos.

Esta herramienta permite designar a un contacto de confianza, como un familiar o un amigo, para recibir alertas en situaciones críticas. El sistema actúa cuando detecta que una persona tiene intenciones de autolesionarse o enfrenta riesgos graves para su seguridad física.

La compañía tecnológica explicó que muchos usuarios utilizan el chat para reflexionar sobre problemas personales o buscar apoyo en momentos difíciles. Por esta razón, el asistente digital busca responder con empatía y motivar la búsqueda de ayuda profesional. Ahora, la plataforma añade una capa extra de protección mediante el envío de notificaciones a terceros autorizados cuando identifica un peligro inminente.

El proceso opera mediante sistemas de monitoreo automatizados que analizan si el usuario menciona conductas de riesgo. Un equipo capacitado de OpenAI revisa estas interacciones para confirmar la gravedad del asunto. Si determinan que existe una amenaza real, la plataforma envía un aviso inmediato por correo electrónico o mensaje de texto al contacto elegido.

OpenAI aclaró en su comunicado oficial que esta función busca fomentar la conexión con personas cercanas en momentos de crisis. La herramienta se inspira en los controles parentales ya existentes para menores de edad. Sin embargo, la empresa enfatizó que esta alerta no sustituye a los servicios de emergencia ni a la atención médica profesional.

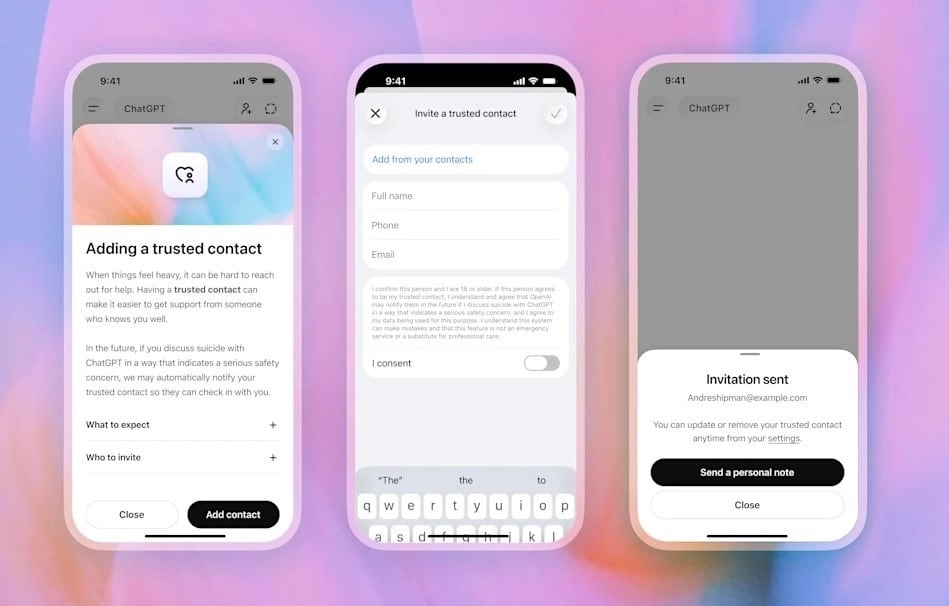

El contacto de confianza debe ser obligatoriamente mayor de edad y se configura desde los ajustes de la aplicación. Una vez seleccionada la persona, esta recibe una invitación con los detalles de su rol preventivo.

La persona designada cuenta con el plazo de una semana para aceptar la solicitud. Si la persona rechaza la invitación, el usuario tiene la opción de nombrar a alguien más para cumplir esta función de apoyo.